Een ETL-pipeline simpel uitgelegd voor developers en beslissers

Business-kant: ETL-pipelines extraheren data uit bronnen, transformeren deze naar een uniform formaat en laden ze in een warehouse. Ze vormen de…

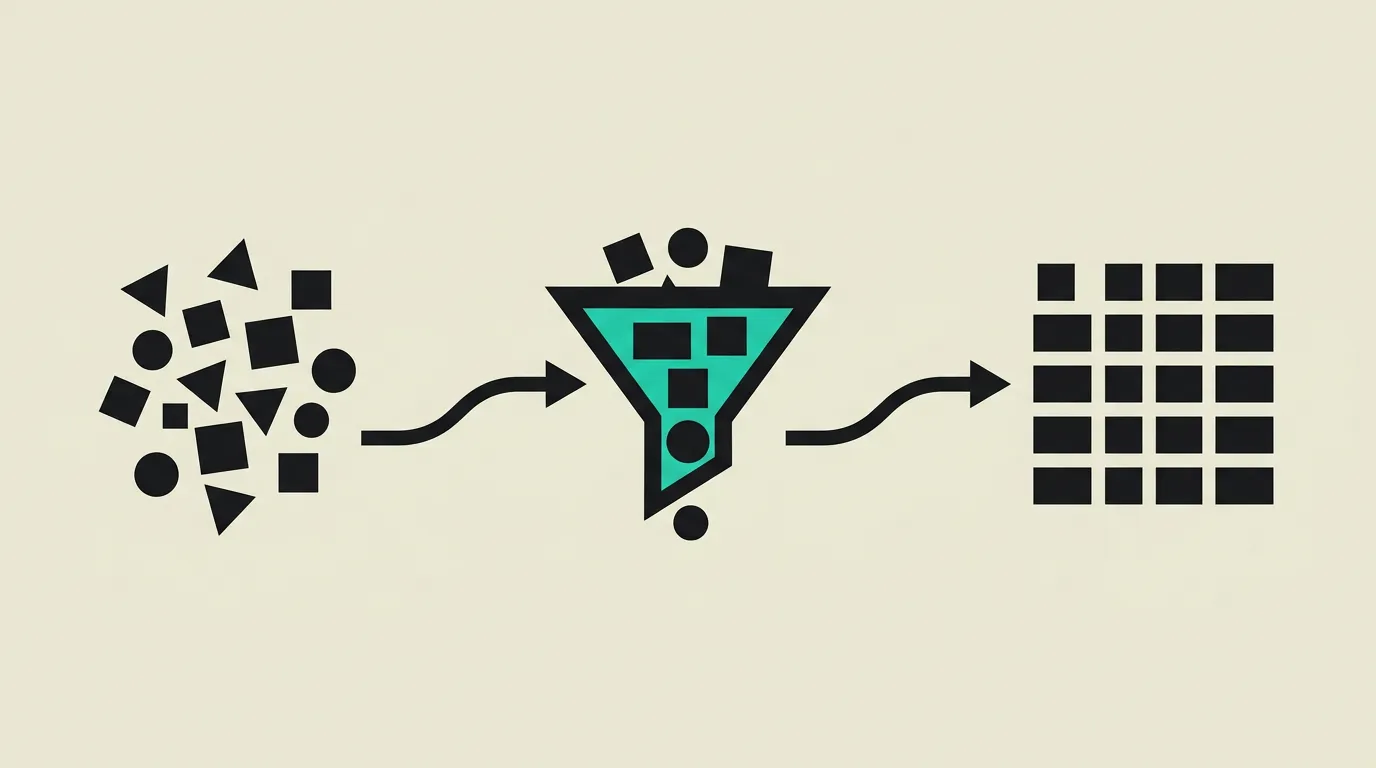

Een ETL-pipeline (Extract, Transform, Load) is een geautomatiseerd proces dat data extraheert uit diverse bronnen, transformeert naar een uniform en analyseklaar formaat, en laadt in een doelsysteem zoals een data warehouse of data lake. Het vormt de ruggengraat van data engineering en maakt het mogelijk om versnipperde data uit meerdere systemen samen te brengen voor betrouwbare rapportages en analyses die de hele organisatie kan gebruiken als single source of truth.

Wat is Een ETL-pipeline simpel uitgelegd voor developers en beslissers?

Een ETL-pipeline (Extract, Transform, Load) is een geautomatiseerd proces dat data extraheert uit diverse bronnen, transformeert naar een uniform en analyseklaar formaat, en laadt in een doelsysteem zoals een data warehouse of data lake. Het vormt de ruggengraat van data engineering en maakt het mogelijk om versnipperde data uit meerdere systemen samen te brengen voor betrouwbare rapportages en analyses die de hele organisatie kan gebruiken als single source of truth.

Hoe werkt Een ETL-pipeline simpel uitgelegd voor developers en beslissers technisch?

Het ETL-proces bestaat uit drie duidelijke fasen. Extract haalt ruwe data op uit diverse bronnen: relationele databases (PostgreSQL, MySQL), API's (REST, GraphQL), bestandssystemen (CSV, Parquet op S3), SaaS-applicaties (Salesforce, HubSpot, Stripe) en event streams (Kafka, Pub/Sub). Transform past cleaning, normalisatie, aggregatie, deduplicatie en business-logica toe om ruwe data om te zetten naar een analyseklaar formaat. Dit omvat het samenvoegen van records uit verschillende bronnen, het converteren van datatypes, het toepassen van valuta-omrekeningen en het berekenen van afgeleide metrics. Load schrijft de getransformeerde data naar het doelsysteem, doorgaans een data warehouse als BigQuery of Snowflake. ELT (Extract, Load, Transform) is de moderne variant waarbij ruwe data eerst in het data warehouse wordt geladen en transformaties daar plaatsvinden met SQL, waarbij de rekenkracht van het warehouse zelf wordt benut. Apache Airflow is de standaard orchestrator: DAGs (Directed Acyclic Graphs) definiëren afhankelijkheden tussen taken met scheduling, retries, SLA-monitoring en alerting via Slack of PagerDuty. dbt (data build tool) focust op de Transform-stap met SQL-modellen die automatisch worden getest op schema-correctheid, unieke keys en niet-null constraints. Fivetran en Airbyte automatiseren de Extract- en Load-stap met honderden kant-en-klare connectors voor populaire datasources. Idempotente pipelines garanderen dat herhaalde runs hetzelfde resultaat opleveren door upserts of merge statements te gebruiken. Data quality frameworks zoals Great Expectations of dbt tests valideren data op completeness, uniqueness, consistency en referentiële integriteit voordat downstream processen ze consumeren. Change Data Capture (CDC) vangt wijzigingen in brondatabases op via het transactielogboek (WAL in PostgreSQL, binlog in MySQL) en streamt alleen gewijzigde rijen naar de pipeline, wat het volume en de belasting op de bron drastisch verlaagt vergeleken met full-table scans. Tools als Debezium integreren met Kafka voor real-time CDC. Incrementele modellen in dbt verwerken alleen nieuwe of gewijzigde data op basis van een configured_at kolom of unieke sleutel, waardoor transformatietijden dalen van uren naar minuten bij groeiende datasets. Backfill-strategieën definiëren hoe historische data opnieuw wordt geladen na schema-wijzigingen of logica-aanpassingen, zonder bestaande data te corrumperen. Lineage tracking via tools als dbt lineage en Marquez visualiseert de volledige afhankelijkheidsketen van bron tot dashboard.

Hoe past MG Software Een ETL-pipeline simpel uitgelegd voor developers en beslissers toe in de praktijk?

MG Software bouwt ETL- en ELT-pipelines voor klanten die data uit meerdere bronnen willen consolideren in een centrale analytics-omgeving. We gebruiken Apache Airflow voor orchestratie van complexe DAGs met afhankelijkheden en retries, en dbt voor het modelleren en testen van SQL-transformaties. Voor extractie configureren we Airbyte-connectors of schrijven custom Python-extractors wanneer standaardconnectors niet volstaan. We implementeren CDC via Debezium wanneer near-realtime data nodig is en configureren dead-letter queues voor onverwerkbare records die handmatig worden geïnspecteerd. Lineage documentation genereren we automatisch via dbt, zodat analisten kunnen traceren waar elke metric vandaan komt en welke transformaties zijn toegepast. Pipelines draaien op geautomatiseerde schedules en worden gemonitord met alerting bij fouten en data quality violations. Dit stelt onze klanten in staat om betrouwbare, actuele en geteste data in hun warehouse en dashboards te hebben.

Waarom is Een ETL-pipeline simpel uitgelegd voor developers en beslissers belangrijk?

Zonder gestructureerde data pipelines blijft waardevolle data opgesloten in afzonderlijke systemen. Marketing kijkt in Google Analytics, finance in het boekhoudsysteem en sales in het CRM, maar niemand heeft het totaalplaatje. ETL-pipelines brengen deze data samen in een betrouwbaar, getest en geautomatiseerd proces. Handmatige data-exports kosten uren per week en zijn foutgevoelig. Geautomatiseerde pipelines draaien onbeheerd en leveren consistente resultaten, ongeacht of het team aanwezig is. De time-to-insight daalt van dagen naar uren of zelfs minuten, waardoor de organisatie sneller kan reageren op veranderingen in de markt of klantgedrag. Hierdoor kan de hele organisatie werken met dezelfde KPI-definities, worden handmatige exports in spreadsheets overbodig, en krijgen beslissers actuele inzichten in plaats van verouderde rapportages die dagen kosten om samen te stellen.

Veelgemaakte fouten met Een ETL-pipeline simpel uitgelegd voor developers en beslissers

Niet-idempotente runs dubbelen rijen bij een herstart of laten halve loads achter in het warehouse. Bronschema's wijzigen zonder contract (schema drift) en breken nachtjobs stilletjes, waardoor dashboards wekenlang verkeerde cijfers tonen. Lokaal geteste transformaties falen in productie door tijdzone-verschillen, character encoding of locale-instellingen. Foutieve records verdwijnen zonder dead-letter queue, waardoor dataverlies onzichtbaar blijft. Alles gaat naar reporting als rauwe ELT met ongeteste ad-hoc SQL, waardoor elke afdeling andere omzetcijfers rapporteert. Lineage is ongedocumenteerd, waardoor niemand weet welke dashboards breken bij upstream wijzigingen. Pipelines worden gebouwd zonder alerting op data freshness, zodat stakeholders dagen met verouderde data werken zonder het te beseffen.

Welke voorbeelden zijn er van Een ETL-pipeline simpel uitgelegd voor developers en beslissers?

- Een marketingteam dat een ETL-pipeline bouwt om dagelijks data uit Google Analytics, Facebook Ads, LinkedIn Ads en hun HubSpot CRM te combineren in BigQuery voor een geïntegreerd marketingdashboard dat channel-attributie, cost-per-acquisition en return on ad spend per campagne berekent.

- Een fintech-bedrijf dat met Airflow elke nacht transactiedata uit meerdere betaalproviders (Stripe, Mollie, Adyen) extraheert, normaliseert naar een uniform transactiemodel, en in Snowflake laadt voor compliance-rapportage, fraudedetectie en realtime transactiemonitoring.

- Een e-commerce platform dat dbt-modellen gebruikt om ruwe besteldata te transformeren naar geaggregeerde revenue-metrics per productcategorie, regio en tijdsperiode, inclusief automatische tests die verifiëren dat de totaalomzet klopt met de brondata.

- Een SaaS-bedrijf dat Airbyte inzet om dagelijks productgebruiksdata uit hun PostgreSQL-database en Segment events te laden in BigQuery, waarna dbt-modellen churn-risicoscores, feature-adoptie en cohortanalyses berekenen.

- Een zorginstelling die nachtelijke ETL-runs draait om patiëntuitkomsten uit drie verschillende ziekenhuissystemen te combineren tot gestandaardiseerde kwaliteitsrapportages voor de Inspectie Gezondheidszorg.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

Data Engineering uitgelegd: wat het is en waarom het belangrijk is

Meetbaar verschil: Data engineering ontwerpt en bouwt de pipelines en infrastructuur die ruwe data transformeren tot bruikbare inzichten voor analyse…

Van idee tot implementatie: Data Migratie voorbeelden

Van scope tot oplevering: ontdek hoe data Migratie het verschil maakt in snelheid, kwaliteit en gebruikersgemak.

Wat is een API? Betekenis, werking en toepassing in moderne software

Een API (Application Programming Interface) koppelt softwaresystemen via gestandaardiseerde protocollen: van betaalintegraties en CRM-koppelingen tot real-time data-uitwisseling tussen apps, microservices en externe platformen.

SaaS uitgelegd: wat het is, hoe het werkt en waarom bedrijven kiezen voor cloud software

SaaS (Software as a Service) levert software via de cloud op abonnementsbasis, zonder lokale installaties. Uw team krijgt automatische updates, schaalbaarheid en toegang vanaf elk apparaat met een internetverbinding.