Load Balancing ontrafeld: wat het is en hoe je ermee werkt

Zo past het in je stack: Load balancing verdeelt inkomend verkeer over meerdere servers zodat geen enkel systeem overbelast raakt. Dat is de basis…

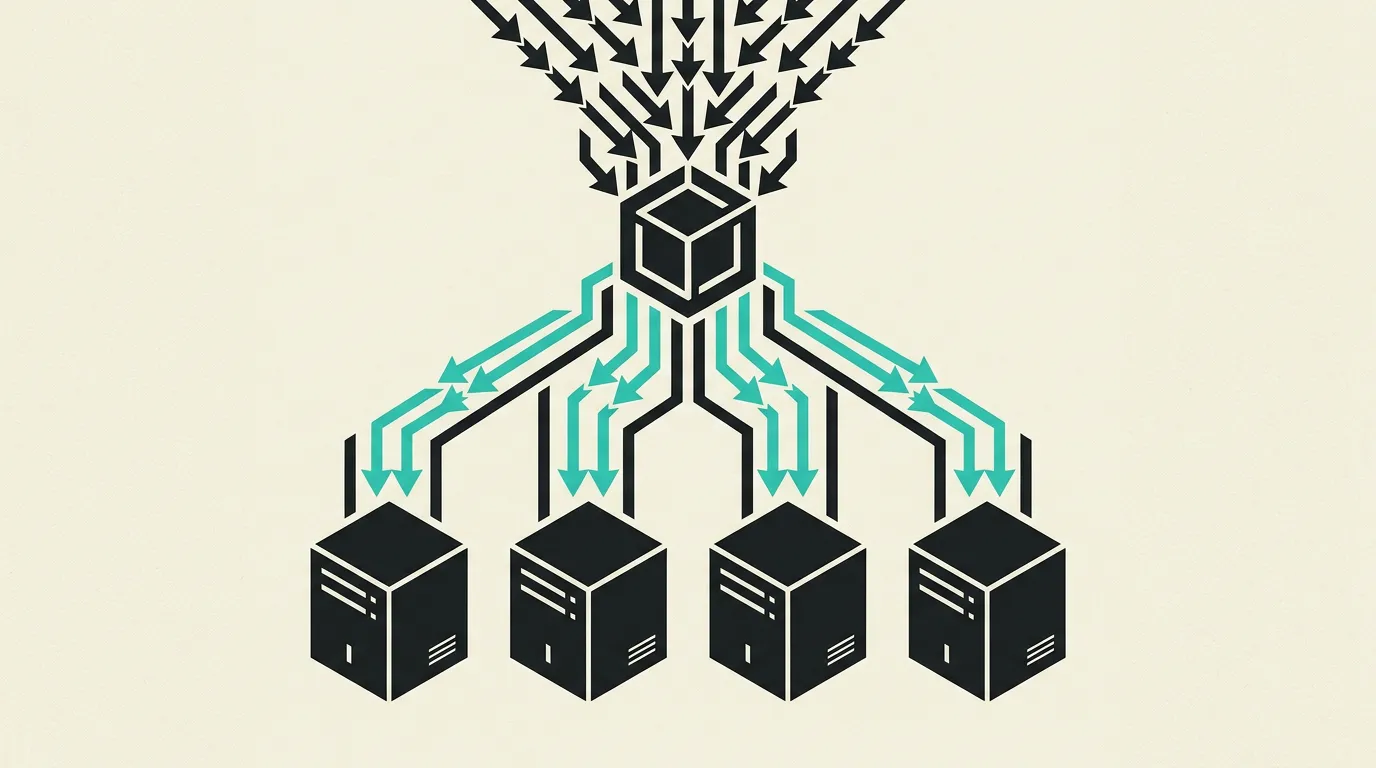

Load balancing is het verdelen van inkomend netwerkverkeer over meerdere servers om de belasting gelijkmatig te spreiden en single points of failure te elimineren. Dit verhoogt de beschikbaarheid, betrouwbaarheid en prestaties van applicaties aanzienlijk. Een load balancer fungeert als verkeersregelaar die verzoeken afvangt en doorsturt naar de meest geschikte backend-server, op basis van gezondheid, beschikbare capaciteit en geconfigureerde routeringsregels.

Wat is Load Balancing ontrafeld: wat het is en hoe je ermee werkt?

Load balancing is het verdelen van inkomend netwerkverkeer over meerdere servers om de belasting gelijkmatig te spreiden en single points of failure te elimineren. Dit verhoogt de beschikbaarheid, betrouwbaarheid en prestaties van applicaties aanzienlijk. Een load balancer fungeert als verkeersregelaar die verzoeken afvangt en doorsturt naar de meest geschikte backend-server, op basis van gezondheid, beschikbare capaciteit en geconfigureerde routeringsregels.

Hoe werkt Load Balancing ontrafeld: wat het is en hoe je ermee werkt technisch?

Load balancers opereren op verschillende OSI-lagen: Layer 4 (transport) verdeelt verkeer op basis van IP en TCP/UDP-poort zonder pakketinhoud te inspecteren, wat resulteert in zeer lage latency. Layer 7 (applicatie) neemt inhoudelijke beslissingen op basis van HTTP-headers, URL-paden, cookies of zelfs request body, wat geavanceerde routeringsscenario's mogelijk maakt. Veelgebruikte algoritmen zijn round-robin (verzoeken gelijkmatig verdelen in vaste volgorde), least connections (naar de server met de minste actieve verbindingen), weighted round-robin (servers met meer capaciteit krijgen proportioneel meer verkeer), IP hash (consistente routing op basis van client-IP voor sessie-affiniteit) en least response time (naar de server met de snelste responstijd). Health checks monitoren continu de gezondheid van backend-servers via HTTP-endpoints, TCP-checks of custom scripts; ongezonde servers worden automatisch uit de pool verwijderd en weer toegevoegd zodra ze herstellen. Session persistence (sticky sessions) zorgt ervoor dat een gebruiker steeds naar dezelfde server wordt gerouteerd, noodzakelijk wanneer sessiestate lokaal op de server leeft. NGINX en HAProxy zijn populaire softwarematige load balancers met uitgebreide configuratiemogelijkheden. Cloudproviders bieden managed oplossingen zoals AWS ALB/NLB, Google Cloud Load Balancer en Azure Load Balancer met ingebouwde autoscaling en health monitoring. SSL-terminatie op de load balancer verlaagt de cryptografische belasting op backend-servers doordat TLS-handshakes centraal worden afgehandeld. Auto-scaling groepen koppelen aan load balancers zodat servers automatisch worden toegevoegd bij toenemend verkeer en verwijderd wanneer de piek voorbij is, wat kosten optimaliseert. Global Server Load Balancing (GSLB) verdeelt verkeer over meerdere datacenters of regio's via DNS-based routing, zodat gebruikers automatisch naar het dichtstbijzijnde cluster worden gestuurd voor lagere latency en hogere beschikbaarheid bij regionale outages. Canary deployments worden mogelijk door een klein percentage verkeer via weighted routing naar een nieuwe applicatieversie te sturen, zodat fouten kunnen worden gedetecteerd voordat alle gebruikers worden geraakt. PROXY Protocol (v1/v2) behoudt het originele client-IP-adres door de gehele chain van load balancers en reverse proxies heen, wat essentieel is voor correcte geolocatie, access logging en rate limiting op het daadwerkelijke bronadres. WebSocket-aware load balancers houden langlevende verbindingen intact via connection upgrade detection en voorkomen dat idle timeouts deze voortijdig beeindigen.

Hoe past MG Software Load Balancing ontrafeld: wat het is en hoe je ermee werkt toe in de praktijk?

MG Software implementeert load balancing in alle productieomgevingen van klanten. We gebruiken NGINX als reverse proxy en load balancer voor webapplicaties, en cloud-native load balancers bij Vercel en AWS. Bij Kubernetes-deployments configureren we Ingress-controllers die verkeer intelligent verdelen over pods. We stellen health checks in op applicatieniveau (niet alleen TCP) zodat servers die vastlopen maar nog bereikbaar zijn automatisch uit rotatie worden gehaald. SSL-terminatie vindt plaats op de load balancer, waarna intern verkeer via een vertrouwd netwerk loopt. Dit zorgt ervoor dat onze klantapplicaties beschikbaar blijven tijdens verkeerspieken, deployments en onderhoud. We implementeren canary deployments via weighted routing, waarbij we initieel vijf procent van het verkeer naar een nieuwe versie sturen en de foutpercentages en latency monitoren voordat we volledig uitrollen. Connection draining is standaard geconfigureerd met een timeout van 30 seconden zodat lopende verzoeken altijd netjes worden afgerond zonder fouten voor de eindgebruiker, ook tijdens rolling updates in Kubernetes.

Waarom is Load Balancing ontrafeld: wat het is en hoe je ermee werkt belangrijk?

Zonder load balancing is je applicatie afhankelijk van een enkele server, wat een single point of failure creëert. Bij een serverstoring of verkeerspiek worden alle gebruikers getroffen. Load balancing elimineert dit risico door verkeer te verdelen, failover te automatiseren en horizontale schaling mogelijk te maken. Voor bedrijven betekent dit hogere uptime, betere gebruikerservaring onder belasting en de mogelijkheid om servers toe te voegen zonder downtime, wat direct bijdraagt aan klanttevredenheid en omzet. Financieel maakt load balancing auto-scaling mogelijk: servers worden alleen ingezet wanneer nodig en automatisch afgeschaald in daluren, wat de maandelijkse cloudkosten aanzienlijk verlaagt. Bovendien stelt het teams in staat om zero-downtime deployments uit te voeren, zodat updates live gaan zonder onderhoudsmeldingen of geplande downtime die klanten wegjagen.

Veelgemaakte fouten met Load Balancing ontrafeld: wat het is en hoe je ermee werkt

Health checks pingen alleen poort 80 of controleren alleen of TCP open is, terwijl de applicatie zelf vastloopt op een interne fout, waardoor verkeer naar effectief dode nodes blijft gaan. Sticky sessions worden ingesteld zonder expiratie en pinnen gebruikers permanent op een enkele machine die niet meeschaalt. Teams denken dat een load balancer automatisch de database schaalt, terwijl de datastore alsnog het knelpunt wordt. SSL-terminatie wordt vergeten en elke backend doet onnodig zware TLS-handshakes. Connection draining is niet geconfigureerd, waardoor lopende verzoeken worden afgebroken tijdens deploys. Het gewicht van servers in weighted routing wordt niet aangepast wanneer de capaciteit verandert, waardoor krachtigere machines onderbenut blijven en zwakkere machines overbelast raken. Logging op de load balancer registreert geen upstream-latency, waardoor het onmogelijk is om trage backends te identificeren vanuit de balancer-metrics.

Welke voorbeelden zijn er van Load Balancing ontrafeld: wat het is en hoe je ermee werkt?

- Een nieuwswebsite die tijdens breaking news met NGINX round-robin load balancing het verkeer verdeelt over tien applicatieservers om miljoenen gelijktijdige bezoekers te bedienen zonder merkbare vertraging, terwijl auto-scaling automatisch extra servers toevoegt als de belasting blijft stijgen.

- Een SaaS-platform dat AWS Application Load Balancer gebruikt om API-verzoeken te routeren naar de juiste microservice op basis van URL-pad en HTTP-headers, met automatische health checks die ongezonde containers binnen seconden uit de pool verwijderen en pas weer toevoegen na succesvolle herstelcontroles.

- Een e-commerce site die weighted load balancing inzet om tijdens een geleidelijke migratie meer verkeer naar nieuwe, krachtigere servers te sturen terwijl oude servers nog als fallback dienen.

- Een videostreaming-dienst die least-connections load balancing gebruikt om transcoderingsjobs te verdelen over GPU-servers, zodat geen enkele machine overbelast raakt terwijl andere inactief zijn.

- Een banking-applicatie die IP-hash load balancing combineert met WebSocket-ondersteuning, zodat langlevende verbindingen consistent naar dezelfde backend worden gerouteerd voor transactie-integriteit.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

Wat is een API? Betekenis, werking en toepassing in moderne software

Een API (Application Programming Interface) koppelt softwaresystemen via gestandaardiseerde protocollen: van betaalintegraties en CRM-koppelingen tot real-time data-uitwisseling tussen apps, microservices en externe platformen.

SaaS uitgelegd: wat het is, hoe het werkt en waarom bedrijven kiezen voor cloud software

SaaS (Software as a Service) levert software via de cloud op abonnementsbasis, zonder lokale installaties. Uw team krijgt automatische updates, schaalbaarheid en toegang vanaf elk apparaat met een internetverbinding.

Cloud Computing uitgelegd: definitie, modellen, voordelen en zakelijke toepassingen

Cloud computing vervangt dure lokale servers door flexibele, schaalbare IT-infrastructuur via IaaS, PaaS en SaaS bij providers als AWS, Azure en Google Cloud. Ontdek hoe het werkt en wat het oplevert.

Qwik alternatieven voor projecten die nu al moeten presteren

Resumability klinkt veelbelovend, maar het ecosysteem is nog klein. Vijf frameworks die vandaag al leveren wat Qwik belooft.