Alles wat je moet weten over een Message Queue

Vaak onderschat, groot effect: Message queues ontkoppelen systeemcomponenten via asynchrone communicatie, bijvoorbeeld met RabbitMQ en Kafka voor…

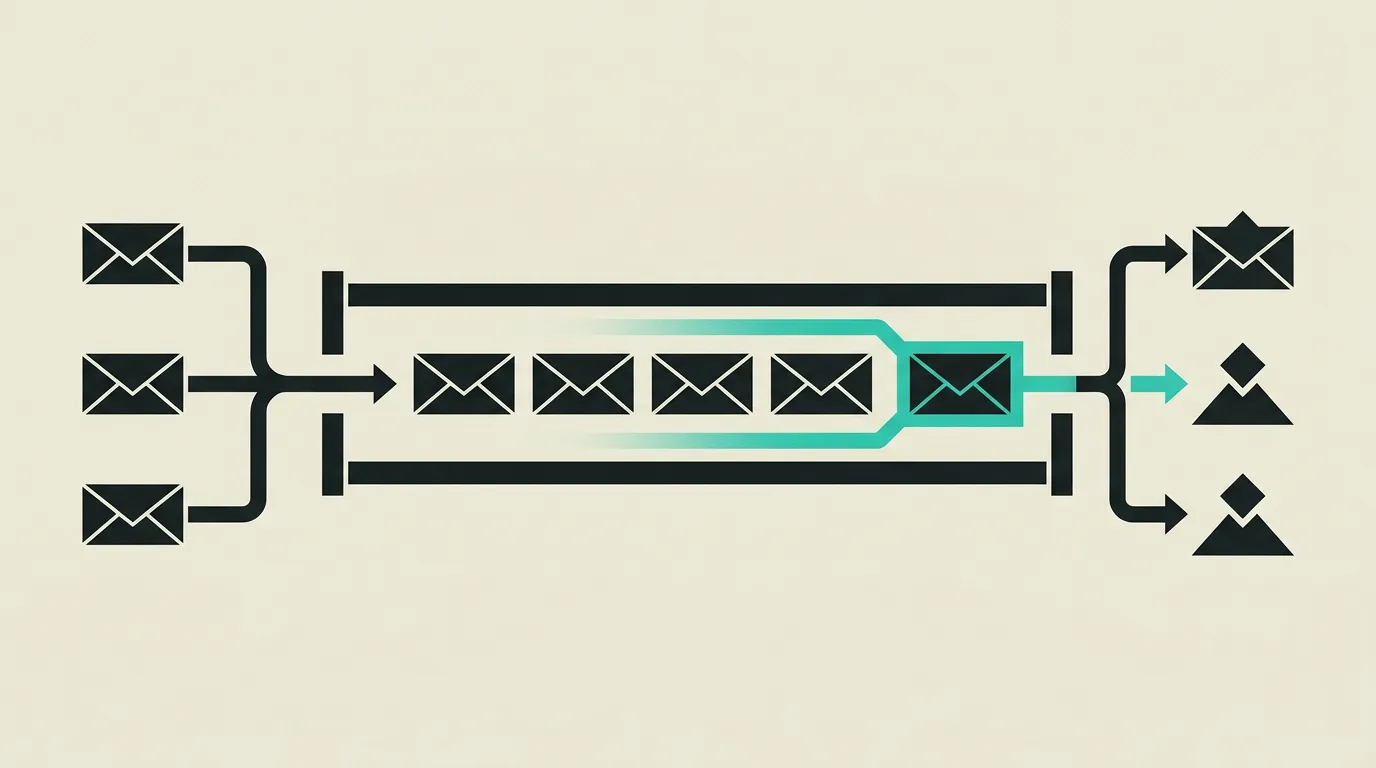

Een message queue is een communicatiemechanisme waarbij berichten tijdelijk worden opgeslagen in een wachtrij totdat de ontvanger ze kan verwerken. Dit ontkoppelt de verzender (producer) van de ontvanger (consumer) en maakt asynchrone verwerking mogelijk, zonder dat beide partijen gelijktijdig beschikbaar hoeven te zijn. Message queues zijn een kernonderdeel van gedistribueerde systemen en event-driven architecturen, waar ze zorgen voor betrouwbare, gegarandeerde communicatie tussen losstaande applicatiecomponenten.

Wat is Alles wat je moet weten over een Message Queue?

Een message queue is een communicatiemechanisme waarbij berichten tijdelijk worden opgeslagen in een wachtrij totdat de ontvanger ze kan verwerken. Dit ontkoppelt de verzender (producer) van de ontvanger (consumer) en maakt asynchrone verwerking mogelijk, zonder dat beide partijen gelijktijdig beschikbaar hoeven te zijn. Message queues zijn een kernonderdeel van gedistribueerde systemen en event-driven architecturen, waar ze zorgen voor betrouwbare, gegarandeerde communicatie tussen losstaande applicatiecomponenten.

Hoe werkt Alles wat je moet weten over een Message Queue technisch?

Message queues implementeren het producer-consumer patroon: producers sturen berichten naar een queue, consumers halen deze op en verwerken ze onafhankelijk. RabbitMQ is een veelgebruikte AMQP-broker die exchanges, bindings en routing keys ondersteunt voor complexe routeringspatronen zoals direct, topic, fanout en headers exchange. RabbitMQ biedt bevestigingsmechanismen (acks) waarmee consumers melden dat een bericht succesvol is verwerkt, zodat het pas dan uit de queue wordt verwijderd. Apache Kafka is een gedistribueerd streaming platform dat berichten in geordende, onveranderlijke logs (partities) opslaat. Kafka biedt hoge throughput (miljoenen berichten per seconde), persistentie en replay-mogelijkheden, wat het geschikt maakt voor event sourcing en audittrails. Consumer groups in Kafka verdelen de verwerking automatisch over meerdere consumers voor horizontale schaalbaarheid. Dead letter queues (DLQ) vangen berichten op die niet succesvol verwerkt kunnen worden na een configureerbaar aantal pogingen. Idempotency-patronen, zoals het meesturen van een uniek message-ID, voorkomen dubbele verwerking bij retries. Backpressure-mechanismen beschermen consumers tegen overbelasting door de productiesnelheid te reguleren. Cloud-native alternatieven zoals AWS SQS, Google Cloud Pub/Sub en Azure Service Bus bieden managed queueing zonder operationeel beheer. Event-driven architecturen gebruiken message queues om services te ontkoppelen: elke service publiceert events en reageert op events van andere services, wat losse koppeling, betere schaalbaarheid en onafhankelijke deployments oplevert. Message serialization via Avro of Protocol Buffers in combinatie met een Schema Registry (Confluent Schema Registry bij Kafka) garandeert backward- en forward-compatibiliteit wanneer berichtformaten evolueren, zonder dat alle consumers tegelijk moeten worden bijgewerkt. Kafka biedt sinds versie 0.11 ondersteuning voor exactly-once delivery semantics via idempotente producers en transactionele consumers, wat duplicaatverwerking op brokersniveau elimineert. Berichtordening is gegarandeerd binnen een enkele Kafka-partitie; voor globale ordening is een enkelvoudig-partitie topic nodig, wat de maximale throughput beperkt. RabbitMQ ondersteunt priority queues waarmee urgentere berichten eerder worden verwerkt, en quorum queues die via Raft-consensus replicatie bieden voor hogere duurzaamheid bij clusterstoringen. Message TTL op zowel queue- als berichtniveau voorkomt dat verouderde berichten onnodig resources blijven consumeren.

Hoe past MG Software Alles wat je moet weten over een Message Queue toe in de praktijk?

Bij MG Software gebruiken we message queues voor het ontkoppelen van tijdrovende taken zoals e-mailverzending via Resend, PDF-generatie en betalingsverwerking. In microservice-architecturen zetten we RabbitMQ of cloud-native alternatieven zoals AWS SQS in zodat services onafhankelijk kunnen schalen. Elke queue-consumer is idempotent ontworpen en bevat retry-logica met exponential backoff. We monitoren queue-diepte en consumerlag via dashboards en alerts, zodat problemen worden gesignaleerd voordat ze impact hebben op eindgebruikers. Dit garandeert dat klantapplicaties responsief blijven, ook bij piekbelasting, terwijl achtergrondtaken betrouwbaar worden afgewerkt. Elk bericht bevat een correlatie-ID zodat we de volledige verwerkingsketen end-to-end kunnen traceren door onze logging-stack. Dead letter queues hebben dedicated alerting, en we bouwen admin-tooling waarmee het team berichten kan inspecteren, de fout kan achterhalen en berichten met een klik kan herplaatsen in de originele queue na het oplossen van het probleem.

Waarom is Alles wat je moet weten over een Message Queue belangrijk?

Zonder message queues zijn applicatiecomponenten direct aan elkaar gekoppeld: als een downstream service traag is of uitvalt, merkt de gebruiker dat onmiddellijk. Een queue absorbeert pieken, garandeert dat geen enkel bericht verloren gaat en maakt het mogelijk om services onafhankelijk te deployen en te schalen. Voor bedrijven betekent dit hogere beschikbaarheid, betere gebruikerservaring tijdens piekbelasting en de flexibiliteit om nieuwe features te bouwen zonder bestaande systemen te verstoren. Financieel gezien verlagen queues infrastructuurkosten doordat workloads worden gespreid in plaats van dat je servers provisioneert voor piekcapaciteit die het grootste deel van de tijd onbenut blijft. Teams kunnen sneller ontwikkelen omdat services onafhankelijk van elkaar worden gereleased, wat de time-to-market voor nieuwe functionaliteit verkort en het risico per deployment vermindert.

Veelgemaakte fouten met Alles wat je moet weten over een Message Queue

Berichten worden uit de queue gehaald (geacked) voordat de verwerking klaar is, waarna een crash de data voorgoed verliest zonder dead-letter of retry. Teams gebruiken een queue als database en ontdekken te laat dat berichten expiren of niet doorzoekbaar zijn. Zonder idempotente consumers leiden retries tot dubbele bestellingen of betalingen. Monitoring op consumer lag ontbreekt, waardoor uitval eruitziet als stilte totdat klanten klagen. Backpressure is niet geconfigureerd en producers overspoelen de queue totdat het geheugen vol raakt. Berichtformaten worden gewijzigd zonder schema-versionering, waardoor bestaande consumers crashen op berichten die ze niet meer kunnen deserialiseren. Poison messages, berichten die structureel onverwerkbaar zijn, blokkeren de hele queue wanneer er geen mechanisme is om ze na herhaalde mislukkingen naar een DLQ te verplaatsen.

Welke voorbeelden zijn er van Alles wat je moet weten over een Message Queue?

- Een webshop die bestellingen direct bevestigt aan de klant via de browser terwijl de daadwerkelijke voorraadcontrole, betaalverwerking en e-mailbevestiging via een message queue asynchroon plaatsvinden, zodat de gebruiker geen wachttijd ervaart en de bestelconversie niet daalt door trage backend-services.

- Een notificatieservice die via Kafka events ontvangt van verschillende microservices en deze bundelt tot push-notificaties, e-mails en in-app berichten naar mobiele gebruikers, met deduplicatie om dubbele meldingen te voorkomen en prioriteitsortering die urgente meldingen eerder aflevert.

- Een data-pipeline die ruwe logbestanden via RabbitMQ distribueert naar meerdere workers die parallel de data transformeren, valideren en opslaan in een data warehouse, waarbij elke worker onafhankelijk kan falen en herstarten zonder impact op de rest van de pipeline.

- Een videoplatform dat geupload materiaal in een queue plaatst voor transcodering naar meerdere resoluties, waarbij elke transcoderingstaak onafhankelijk wordt verwerkt door workers die horizontaal meeschalen met het aantal uploads.

- Een IoT-systeem dat sensordata van duizenden apparaten via MQTT naar een Kafka-cluster streamt, waar real-time analyses draaien terwijl de ruwe data gelijktijdig wordt gearchiveerd voor historische rapportage.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

Het verschil tussen Kafka en RabbitMQ uitgelegd

Kafka houdt gigantische logs met replay; RabbitMQ routeert jobs en commands met bewezen patronen. Kies naar volgorde versus flex.

Microservices architectuur: definitie, patronen en wanneer je ze inzet in de praktijk

Microservices splitsen complexe applicaties op in kleine, onafhankelijke services die apart worden ontwikkeld, getest, gedeployd en geschaald. Ontdek wanneer een microservice-architectuur daadwerkelijk waarde toevoegt, hoe services onderling communiceren en hoe je de valkuilen van gedistribueerde systemen effectief vermijdt.

De essentie van gRPC: betekenis en gebruik

Technisch gezien gRPC gebruikt Protocol Buffers voor binaire, getypte communicatie tussen microservices, tot wel tien keer sneller dan REST voor…

De essentie van een Webhook: betekenis en gebruik

Webhooks sturen automatisch HTTP-callbacks wanneer events plaatsvinden, voor real-time notificaties en event-driven integraties tussen systemen.