De essentie van gRPC: betekenis en gebruik

Technisch gezien gRPC gebruikt Protocol Buffers voor binaire, getypte communicatie tussen microservices, tot wel tien keer sneller dan REST voor…

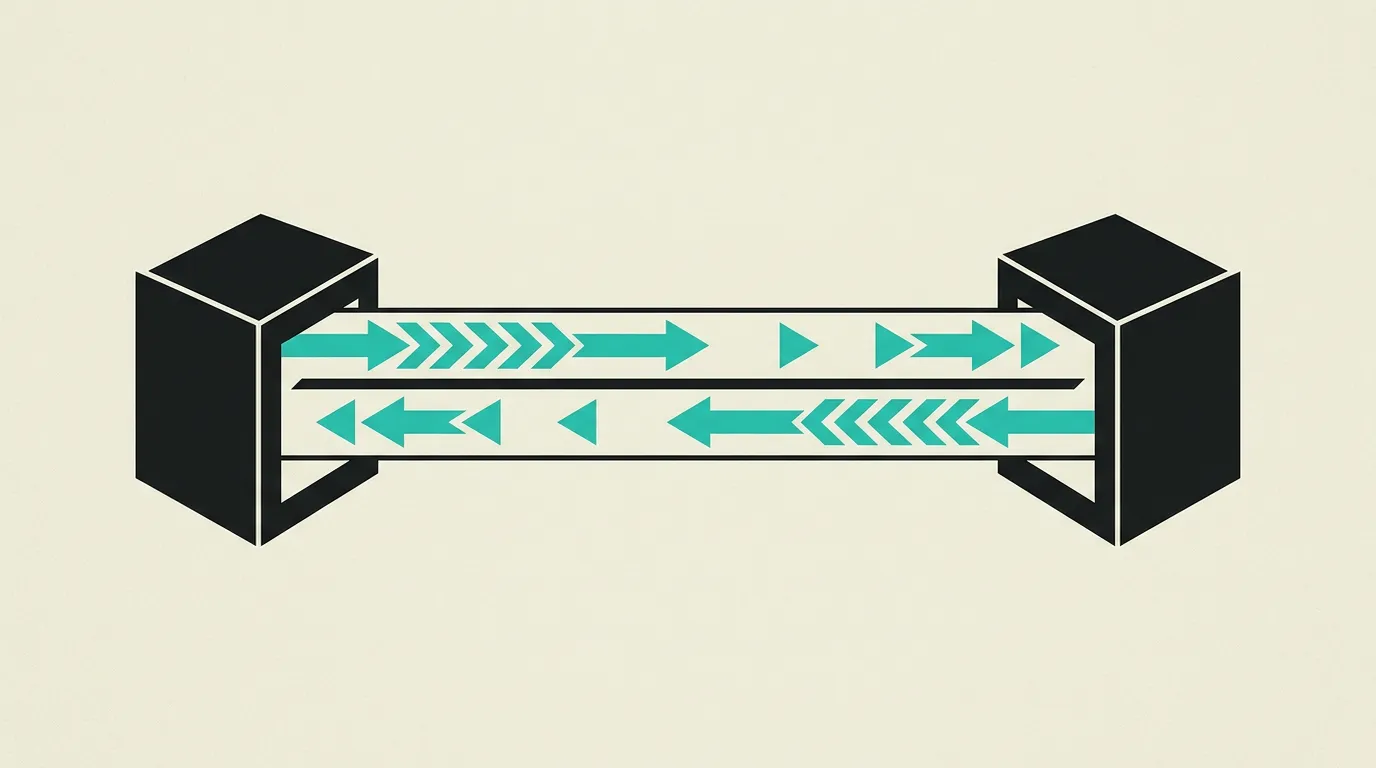

gRPC is een open-source Remote Procedure Call (RPC) framework dat oorspronkelijk is ontwikkeld door Google en Protocol Buffers gebruikt voor efficiënte, sterk-getypeerde communicatie tussen services over een netwerk. Het draait op HTTP/2 als transportlaag en biedt significant hogere prestaties dan traditionele REST API's door binaire serialisatie, multiplexing van meerdere streams over een enkele TCP-verbinding en ingebouwde ondersteuning voor streaming. gRPC is de standaard geworden voor interne microservice-communicatie in organisaties die hoge throughput, lage latency en taaloverkoepelende codegeneratie nodig hebben.

Wat is De essentie van gRPC: betekenis en gebruik?

gRPC is een open-source Remote Procedure Call (RPC) framework dat oorspronkelijk is ontwikkeld door Google en Protocol Buffers gebruikt voor efficiënte, sterk-getypeerde communicatie tussen services over een netwerk. Het draait op HTTP/2 als transportlaag en biedt significant hogere prestaties dan traditionele REST API's door binaire serialisatie, multiplexing van meerdere streams over een enkele TCP-verbinding en ingebouwde ondersteuning voor streaming. gRPC is de standaard geworden voor interne microservice-communicatie in organisaties die hoge throughput, lage latency en taaloverkoepelende codegeneratie nodig hebben.

Hoe werkt De essentie van gRPC: betekenis en gebruik technisch?

gRPC gebruikt HTTP/2 als transportlaag, wat multiplexing (meerdere requests gelijktijdig over een enkele TCP-verbinding), header compression via HPACK en server push mogelijk maakt. Protocol Buffers (protobuf) serialiseren data in een compact binair formaat dat tot 10x kleiner is dan JSON en aanzienlijk sneller te parseren. Service-definities worden beschreven in .proto-bestanden die met protoc automatisch client- en servercode genereren voor meer dan 12 programmeertalen, waaronder Go, Java, Python, C++, Rust en TypeScript. gRPC ondersteunt vier communicatiepatronen: unary (klassiek request-response), server streaming (server stuurt meerdere berichten terug), client streaming (client stuurt meerdere berichten) en bidirectional streaming (beide kanten sturen gelijktijdig). Deadlines en cancellation propageren automatisch door de volledige service chain. Als een downstream service niet op tijd reageert, worden alle gerelateerde requests geannuleerd, wat resource-verspilling en cascade-failures voorkomt. Interceptors bieden middleware-functionaliteit voor logging, authenticatie, rate limiting en distributed tracing. Load balancing kan client-side plaatsvinden via service discovery (Consul, etcd) of proxy-based via Envoy, dat ook circuit breaking en retry-logica biedt. gRPC-Web maakt het mogelijk om gRPC vanuit browsers aan te roepen via een Envoy of NGINX proxy die HTTP/1.1-verzoeken vertaalt. De Reflection API maakt runtime service discovery mogelijk voor tooling als grpcurl en Postman. Het ingebouwde health checking protocol integreert naadloos met Kubernetes liveness en readiness probes. HTTP/2 flow control werkt op twee niveaus: per stream en per verbinding, waardoor een trage consumer niet alle andere streams op dezelfde connectie blokkeert. Keepalive pings houden verbindingen actief en detecteren dode connecties voordat ze stilzwijgend falen, wat essentieel is in cloudomgevingen waar load balancers inactieve verbindingen na een time-out sluiten. gRPC channelz biedt runtime diagnostiek over actieve kanalen, verbindingsstatistieken en fouttellingen, beschikbaar via een debug-endpoint. Protobuf oneof-velden modelleren polymorfe berichten zonder overerving, wat nuttig is voor event-driven architecturen waar een enkel berichttype meerdere varianten kan bevatten. Service mesh integratie met Istio of Linkerd voegt mTLS, traffic management en observability toe aan gRPC-verkeer zonder applicatiecode te wijzigen.

Hoe past MG Software De essentie van gRPC: betekenis en gebruik toe in de praktijk?

MG Software past gRPC toe in projecten waar hoge throughput en lage latency cruciaal zijn, met name bij interne microservice-communicatie achter een API gateway. We definiëren strikt getypeerde API-contracten via Protocol Buffers in een centrale proto-repository en genereren automatisch client-code voor elke service in zowel TypeScript als Go. Interceptors voegen distributed tracing (OpenTelemetry) en JWT-authenticatie toe zonder business-logica te vervuilen, zodat observability consistent is over alle endpoints. Keepalive-parameters stemmen we af op de load balancer time-outs van de cloudomgeving om stille verbindingsfouten te voorkomen. In onze CI-pipeline draait Buf lint om breaking schema-changes te detecteren voordat ze productie bereiken. We genereren automatisch API-documentatie vanuit .proto-bestanden met protoc-gen-doc en publiceren deze in onze interne developer portal voor alle teamleden en stakeholders. Elke gRPC-service implementeert het standaard health checking protocol dat naadloos integreert met Kubernetes readiness en liveness probes. Voor publieke API's gebruiken we REST of GraphQL met een API gateway die gRPC-to-REST transcoding via Envoy verzorgt, terwijl gRPC de performante interne backbone vormt.

Waarom is De essentie van gRPC: betekenis en gebruik belangrijk?

In een microservice-architectuur vormt inter-service communicatie vaak het grootste knelpunt voor end-to-end latency en betrouwbaarheid. REST met JSON over HTTP/1.1 introduceert serialisatie-overhead, mist native streaming en biedt geen type-safety tussen services. gRPC lost al deze problemen op met binaire serialisatie, multiplexing, ingebouwde streaming en automatische codegeneratie vanuit een gedeeld contract. Dit betekent minder bugs door type-mismatches, lagere latency, hogere throughput en duidelijke API-contracten die als bron van waarheid dienen voor alle teams die een service consumeren. Bij complexe request chains die vijf of meer services aanroepen, bespaart gRPC al snel 50 tot 100 milliseconden per request vergeleken met REST. Die winst vertaalt zich naar een snellere eindgebruikerservaring en lagere infrastructuurkosten, omdat minder CPU-cycles worden besteed aan het serialiseren en deserialiseren van payloads. Voor bedrijven die real-time data-verwerking vereisen, zoals financiele platforms, gaming-backends of IoT-systemen, is het verschil tussen gRPC en REST vaak het verschil tussen een responsief en een traag aanvoelend product.

Veelgemaakte fouten met De essentie van gRPC: betekenis en gebruik

Interne protobuf-API's worden direct naar browsers gestuurd zonder gRPC-Web proxy, waardoor niets werkt omdat browsers de benodigde HTTP/2-primitieven niet blootstellen. Breaking .proto-wijzigingen zoals het hergebruiken van veldnummers of het toevoegen van verplichte velden worden uitgerold zonder versiebeheer en breken oude clients op subtiele manieren, vaak met stille datacorruptie die pas weken later wordt ontdekt. Deadlines en cancellation worden niet ingesteld, waardoor trage downstream services verbindingen laten lekken en cascading failures veroorzaken die het volledige systeem raken. gRPC wordt overal gekozen vanwege het snelheidsnarratief, terwijl REST met HTTP-caching voor bepaalde use cases met publieke API's eenvoudiger en effectiever is. Lange streaming-verbindingen worden niet goed gebalanceerd omdat standaard Layer 4 load balancers op verbindingsniveau werken in plaats van per individuele RPC. Keepalive-instellingen worden niet afgestemd op de cloud load balancer, waardoor connecties stilzwijgend worden gesloten en clients cryptische foutmeldingen ontvangen.

Welke voorbeelden zijn er van De essentie van gRPC: betekenis en gebruik?

- Een betalingsplatform dat gRPC gebruikt voor de communicatie tussen de order-service en payment-service, met bidirectional streaming voor real-time transactiestatus-updates en automatische deadline-propagatie zodat een time-out bij de klant direct alle downstream processing annuleert en geen resources verspild worden.

- Een machine learning platform dat gRPC inzet om model-inferentie requests efficiënt te distribueren naar een cluster van GPU-servers, waarbij protobuf de overhead van JSON-serialisatie volledig elimineert en de gemiddelde response time onder de 10 milliseconden blijft, zelfs bij duizenden gelijktijdige prediction requests per seconde.

- Een gaming-backend die gRPC server streaming gebruikt om real-time gamestate-updates naar alle verbonden spelers te sturen met sub-frame latency, terwijl HTTP/2 multiplexing voorkomt dat een trage spelerverbinding andere streams op dezelfde TCP-connectie blokkeert dankzij per-stream flow control.

- Een logistiek bedrijf dat gRPC client streaming inzet voor voertuigtelemetrie, waarbij honderden vrachtwagens continu GPS-coördinaten en sensordata naar een centrale service sturen die routes in real-time optimaliseert en de compacte protobuf-encoding de benodigde bandbreedte met meer dan 80 procent vermindert ten opzichte van JSON.

- Een e-commerce platform waar de zoekservice, aanbevelingsengine en voorraadservice intern via gRPC communiceren, met strikt gedefinieerde protobuf-contracten in een gedeelde proto-repository die backward compatibility garanderen bij elke onafhankelijke deployment en waar Buf CI-checks breaking changes blokkeren.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

Microservices architectuur: definitie, patronen en wanneer je ze inzet in de praktijk

Microservices splitsen complexe applicaties op in kleine, onafhankelijke services die apart worden ontwikkeld, getest, gedeployd en geschaald. Ontdek wanneer een microservice-architectuur daadwerkelijk waarde toevoegt, hoe services onderling communiceren en hoe je de valkuilen van gedistribueerde systemen effectief vermijdt.

Kennisbank: WebAssembly van definitie tot implementatie

WebAssembly (Wasm) draait gecompileerde code van C++, Rust en Go in de browser met bijna-native snelheid. Leer hoe Wasm werkt en wanneer je het inzet.

Static Site Generation uitgelegd: wat het is en waarom het belangrijk is

Focus op resultaat: Static Site Generation bouwt HTML-pagina\'s tijdens het buildproces en serveert ze via CDN: de snelste en veiligste manier om…

Het verschil tussen een monoliet en microservices voor teams

Monoliet eerst, services later: splits pas op als domeinen en teams echt onafhankelijk kunnen releasen en beheren.