A/B Testing simpel uitgelegd voor developers en beslissers

A/B testing vergelijkt twee varianten van een pagina of feature met echte gebruikers om datagedreven te bepalen welke versie beter presteert op conversie en engagement.

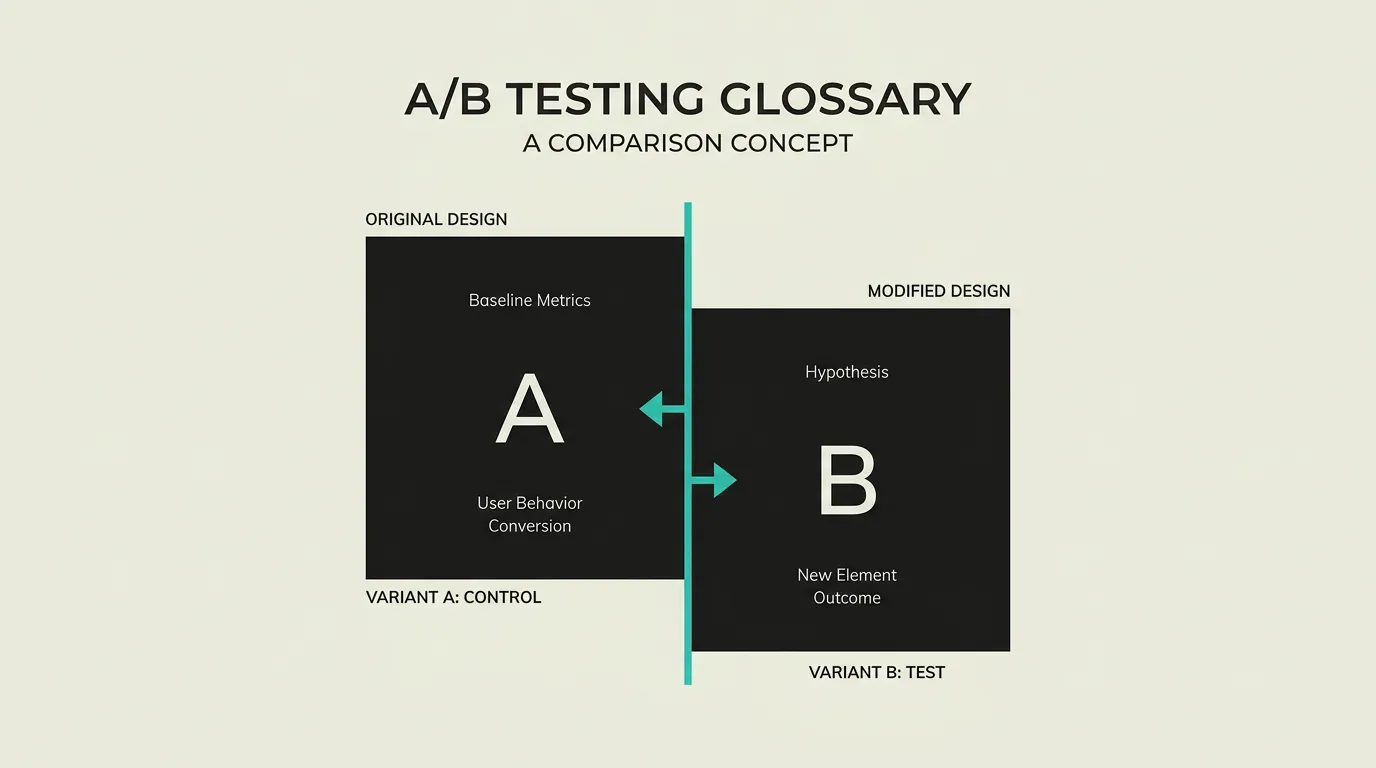

A/B testing, ook wel split testing genoemd, is een experimentele methode waarbij twee of meer versies van een webpagina, e-mail of app-element gelijktijdig aan verschillende gebruikersgroepen worden getoond. Het doel is datagedreven vast te stellen welke variant beter presteert op een vooraf gedefinieerde metric, zoals conversieratio, klikfrequentie of gemiddelde orderwaarde. Door beslissingen te baseren op statistisch bewijs in plaats van meningen, minimaliseert A/B testing het risico van kostbare ontwerpfouten.

Wat is A/B Testing simpel uitgelegd voor developers en beslissers?

A/B testing, ook wel split testing genoemd, is een experimentele methode waarbij twee of meer versies van een webpagina, e-mail of app-element gelijktijdig aan verschillende gebruikersgroepen worden getoond. Het doel is datagedreven vast te stellen welke variant beter presteert op een vooraf gedefinieerde metric, zoals conversieratio, klikfrequentie of gemiddelde orderwaarde. Door beslissingen te baseren op statistisch bewijs in plaats van meningen, minimaliseert A/B testing het risico van kostbare ontwerpfouten.

Hoe werkt A/B Testing simpel uitgelegd voor developers en beslissers technisch?

Bij A/B testing wordt inkomend verkeer willekeurig verdeeld over twee of meer varianten. Variant A fungeert als controle en vertegenwoordigt de huidige versie, terwijl variant B (of C, D enzovoort) de wijziging bevat. De toewijzing kan server-side of client-side plaatsvinden. Server-side testing past de variant toe voordat de HTML naar de browser wordt gestuurd, wat visuele flicker voorkomt en een betere performance oplevert. Client-side testing past wijzigingen toe via JavaScript na het laden van de pagina, wat eenvoudiger te implementeren is maar risico op flicker met zich meebrengt. Statistische significantie, doorgaans op een 95% betrouwbaarheidsniveau, bepaalt of het gemeten verschil in conversie niet door toeval kan worden verklaard. De benodigde steekproefgrootte wordt vooraf berekend met een power analysis op basis van het verwachte effect, de huidige conversieratio en het gewenste betrouwbaarheidsniveau. Een te kleine steekproef leidt tot onbetrouwbare resultaten, terwijl een te grote steekproef onnodig lang duurt. Bayesiaanse statistiek biedt een alternatief voor de klassieke frequentistische benadering. Het voordeel is dat continue monitoring mogelijk is zonder het zogenaamde peeking-probleem, waarbij vroegtijdig stoppen tot vals-positieve conclusies leidt. Multivariate testing breidt het concept uit door meerdere elementen tegelijk te testen in alle mogelijke combinaties, waardoor interactie-effecten zichtbaar worden. Multi-armed bandit algoritmen verdelen verkeer dynamisch en sturen automatisch meer bezoekers naar de beter presterende variant. Feature flags integreren A/B testing in de deployment-pipeline, zodat experimenten als onderdeel van het releaseproces worden beheerd. Platforms als Optimizely, VWO, LaunchDarkly en Statsig bieden volledige workflows voor experiment-management, doelgroepsegmentatie, resultaatanalyse en rapportage. Guardrail-metrieken, secundaire KPI's die naast het primaire doel worden gemonitord, helpen onbedoelde neveneffecten te detecteren. Zo kan een test die aanmeldingen verhoogt, ongemerkt het verloop vergroten als de ervaring verkeerde verwachtingen schept. Mutual exclusion groups zorgen ervoor dat gebruikers die deelnemen aan één experiment worden uitgesloten van conflicterende tests, waardoor interactie-effecten de resultaten niet vertekenen.

Hoe past MG Software A/B Testing simpel uitgelegd voor developers en beslissers toe in de praktijk?

MG Software implementeert A/B testing via feature flags en server-side experimenten in Next.js met behulp van de Edge Middleware voor flikkervrije toewijzing. We begeleiden klanten bij het formuleren van duidelijke hypothesen voordat een experiment start: welk element wordt gewijzigd, welke metric wordt gemeten, en wat is het verwachte effect? Vervolgens zetten we experimenten op voor call-to-action knoppen, formulieren, landingspagina's en prijspresentaties. Resultaten worden geanalyseerd op statistische significantie en gesegmenteerd naar apparaattype, verkeersbron en gebruikerssegment. Na afloop van elk experiment documenteren we de uitkomsten in een centraal experiment-logboek, zodat het hele team leert van eerdere tests en geen hypothesen onnodig herhaald worden. Deze datagedreven aanpak vervangt discussies op basis van onderbuikgevoel door bewijs, wat consequent leidt tot hogere conversies en een beter begrip van het gebruikersgedrag.

Waarom is A/B Testing simpel uitgelegd voor developers en beslissers belangrijk?

A/B testing vervangt aannames en onderbuikgevoel door harde, meetbare data. In plaats van intern te debatteren over welk ontwerp beter is, laat je echte gebruikers met hun gedrag de beslissing nemen. Dit leidt tot aantoonbaar hogere conversies en voorkomt kostbare redesigns die zijn gebaseerd op meningen in plaats van bewijs. Organisaties die structureel experimenteren bouwen een cultuur op waarin elke wijziging een hypothese is die wordt getoetst. Op termijn levert dit een cumulatief voordeel op: tientallen kleine verbeteringen die individueel bescheiden zijn, maar samen een significant effect hebben op omzet en klanttevredenheid. Bovendien verkleint een experimentcultuur de doorlooptijd van besluitvorming, omdat teams niet meer weken hoeven te discussiëren over ontwerp keuzes maar snel een test opzetten en het antwoord uit de data laten spreken.

Veelgemaakte fouten met A/B Testing simpel uitgelegd voor developers en beslissers

De meest voorkomende fout is een test voortijdig stoppen zodra een variant er veelbelovend uitziet. Zonder voldoende data kan het waargenomen verschil puur toeval zijn, wat leidt tot verkeerde beslissingen. Een andere valkuil is te veel elementen tegelijk wijzigen in één A/B test, waardoor het onmogelijk wordt om te bepalen welke specifieke verandering het effect veroorzaakt. Veel teams vergeten ook om rekening te houden met seizoenspatronen en weekdagverschillen in verkeer. Een test die alleen in het weekend draait, is niet representatief voor doordeweeks verkeer. Tot slot wordt het belang van een duidelijke hypothese onderschat. Zonder vooraf te formuleren wat je verwacht en waarom, wordt een experiment een lukrake gok in plaats van een gestructureerd leermoment.

Welke voorbeelden zijn er van A/B Testing simpel uitgelegd voor developers en beslissers?

- Een SaaS-bedrijf dat twee varianten van hun pricing-pagina test: één met maandprijzen prominent en één met jaarprijzen prominent. De jaarvariant verhoogt de gemiddelde contractwaarde met 23% doordat gebruikers eerder voor langere commitment kiezen wanneer de jaarkorting visueel opvalt.

- Een e-commerce site die de kleur en tekst van de "Toevoegen aan winkelwagen"-knop test. Een oranje knop met "Nu bestellen" genereert 15% meer clicks dan een blauwe knop met "In winkelwagen", wat laat zien dat urgentie in microcopy conversie stimuleert.

- Een lead-generatiesite die een kort formulier met drie velden vergelijkt met een uitgebreid formulier met acht velden. Het korte formulier levert 60% meer leads op, maar het lange formulier genereert hogere kwaliteit leads met een betere sales-conversieratio.

- Een nieuwsbrief die twee onderwerpregels test bij een random steekproef van 10% van de mailinglijst. De winnende variant wordt automatisch naar de overige 90% gestuurd, wat de openingsratio van de gehele campagne met 18% verhoogt.

- Een online reisplatform dat de volgorde van zoekresultaten test: prijs-oplopend versus relevantie-gesorteerd. Relevantie-sortering leidt tot 9% meer boekingen doordat gebruikers sneller een passend aanbod vinden.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

User experience gaat verder dan alleen het schermontwerp

UX-design combineert usability, gebruikersonderzoek en informatiearchitectuur om digitale producten te maken die converteren. Ontdek hoe user experience uw bedrijf versterkt.

Web performance: snelheid, Core Web Vitals en conversie

Web performance meet hoe snel uw site laadt en reageert via Core Web Vitals (LCP, INP, CLS). Ontdek de directe impact op SEO-rankings, conversie en gebruikerservaring.

Feature Flags in het kort: definitie, voordelen en toepassingen

Meetbaar verschil: Feature flags schakelen functionaliteit aan of uit zonder deployment, wat geleidelijke rollouts, A/B-tests en veilige trunk-based…

Qwik alternatieven voor projecten die nu al moeten presteren

Resumability klinkt veelbelovend, maar het ecosysteem is nog klein. Vijf frameworks die vandaag al leveren wat Qwik belooft.