Wat is RAG? Betekenis en toepassing uitgelegd

Focus op resultaat: RAG grondt AI-antwoorden in echte data door relevante documenten op te halen vóór generatie. Dit is de sleutel tot betrouwbare,…

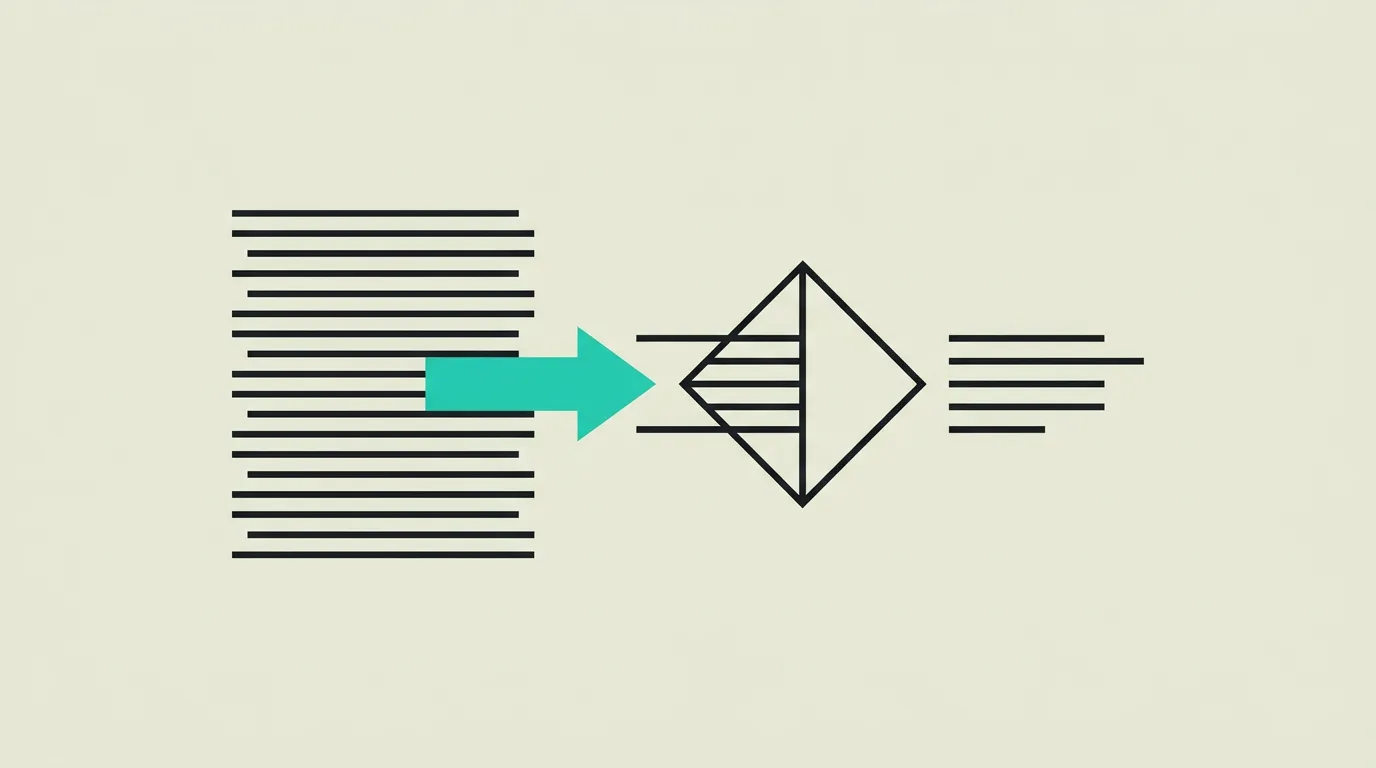

Retrieval-Augmented Generation (RAG) is een AI-architectuurpatroon dat de kennis van een large language model aanvult door relevante informatie op te halen uit externe databronnen voordat een antwoord wordt gegenereerd. Dit vermindert hallucinaties en grondt de output in actuele, verifieerbare data. In plaats van uitsluitend te vertrouwen op de trainingsdata van het model, koppelt RAG het generatieproces aan een doorzoekbare kennisbasis. Hierdoor kunnen organisaties AI-assistenten bouwen die bedrijfsspecifieke vragen beantwoorden met verwijzingen naar de originele brondocumenten.

Wat is RAG?

Retrieval-Augmented Generation (RAG) is een AI-architectuurpatroon dat de kennis van een large language model aanvult door relevante informatie op te halen uit externe databronnen voordat een antwoord wordt gegenereerd. Dit vermindert hallucinaties en grondt de output in actuele, verifieerbare data. In plaats van uitsluitend te vertrouwen op de trainingsdata van het model, koppelt RAG het generatieproces aan een doorzoekbare kennisbasis. Hierdoor kunnen organisaties AI-assistenten bouwen die bedrijfsspecifieke vragen beantwoorden met verwijzingen naar de originele brondocumenten.

Hoe werkt RAG technisch?

RAG werkt in drie fasen: indexering, retrieval en generatie. Tijdens de indexeringsfase worden documenten opgesplitst in chunks, omgezet naar numerieke vectorrepresentaties (embeddings) via een embedding-model zoals OpenAI text-embedding-3 of Cohere Embed, en opgeslagen in een vector database zoals Pinecone, Weaviate of pgvector. De chunking-strategie heeft grote invloed op de kwaliteit: vaste grootten zijn eenvoudig maar respecteren geen documentstructuur, terwijl semantische chunking natuurlijke grenzen als paragrafen en secties volgt voor betere context. Overlap tussen chunks voorkomt dat relevante informatie op de grens tussen twee segmenten verloren gaat. Bij een gebruikersvraag wordt de query eveneens naar een embedding geconverteerd en wordt via similarity search (doorgaans cosine similarity of dot product) de meest relevante chunks opgehaald. Hybrid search combineert vectorgebaseerde retrieval met traditionele keyword-matching (BM25), wat de recall verbetert bij queries die zowel semantische als exacte overeenkomsten vereisen. Dit is vooral waardevol voor domeinspecifieke terminologie en productnamen die semantische modellen niet altijd correct vastleggen. Opgehaalde chunks doorlopen vervolgens een re-ranking fase, waarbij een cross-encoder model de relevantie nauwkeuriger scoort dan de initiële vectorzoekopdracht. De geselecteerde chunks worden als context meegegeven aan het LLM, dat een antwoord genereert gebaseerd op zowel zijn getrainde kennis als de opgehaalde informatie. Geavanceerde RAG-implementaties in 2026 omvatten query expansion die de oorspronkelijke vraag verrijkt met synoniemen en gerelateerde termen, hypothetical document embeddings (HyDE) die een hypothetisch antwoord genereren om betere retrieval te bereiken, en agentic RAG waarbij een AI-agent dynamisch beslist welke databronnen te raadplegen en of er meerdere retrieval-rondes nodig zijn. Metadata-filtering maakt het mogelijk om retrieval te beperken tot specifieke documentcategorieën, datumbereiken of afdelingen, wat de precisie verhoogt bij grote en diverse kennisbanken. Evaluatie van RAG-systemen gebeurt via metrieken als faithfulness, relevance en answer correctness, vaak gemeten met frameworks als RAGAS of DeepEval. Continue evaluatie na lancering is essentieel omdat de kwaliteit van retrieval kan veranderen wanneer nieuwe documenten worden toegevoegd of bestaande worden bijgewerkt.

Hoe past MG Software RAG toe in de praktijk?

RAG is de standaardarchitectuur bij MG Software voor alle AI-oplossingen die bedrijfsspecifieke kennis vereisen. We bouwen RAG-pipelines die interne documenten, kennisbanken en databases ontsluiten via AI, zodat medewerkers in natuurlijke taal vragen kunnen stellen over bedrijfsinformatie en direct onderbouwde antwoorden ontvangen. Onze implementaties gebruiken hybrid search met zowel vector- als keyword-retrieval voor optimale recall, gecombineerd met re-ranking modellen die de meest relevante resultaten bovenaan plaatsen. Chunking-strategieën stemmen we af op het documenttype: juridische teksten worden anders gesegmenteerd dan technische handleidingen of klantcommunicatie, met overlap en metadata-verrijking afgestemd op de specifieke zoekpatronen van de eindgebruikers. Evaluatiemetrieken als faithfulness en relevance monitoren we continu via geautomatiseerde pipelines, zodat degradatie in antwoordkwaliteit direct wordt gesignaleerd en verholpen. Daarnaast implementeren we bronverwijzingen in elke AI-response, waardoor eindgebruikers altijd kunnen verifiëren waar de informatie vandaan komt en het vertrouwen in het systeem groeit.

Waarom is RAG belangrijk?

RAG combineert de taalgeneratie van LLMs met actuele, bedrijfsspecifieke informatie. Hierdoor kunnen organisaties betrouwbare AI-assistenten bouwen die antwoorden baseren op hun eigen documenten in plaats van op mogelijk verouderde trainingsdata. Voor bedrijven die werken met grote hoeveelheden interne documentatie, van handboeken en beleidsnotities tot contracten en technische specificaties, biedt RAG een manier om deze kennis toegankelijk te maken zonder dat medewerkers zelf door honderden bestanden hoeven te zoeken. De bronverwijzingen die RAG-systemen meegeven aan antwoorden creëren transparantie en vertrouwen, essentieel voor adoptie door eindgebruikers die terecht kritisch zijn over AI-gegenereerde informatie. Zonder RAG zijn LLMs beperkt tot hun trainingskennis, die onvermijdelijk veroudert en geen bedrijfsspecifieke informatie bevat. In 2026 is RAG de meest geadopteerde architectuur voor enterprise AI-toepassingen omdat het de betrouwbaarheid en traceerbaarheid biedt die organisaties nodig hebben voor productiewaardige AI in gereguleerde sectoren. Daarnaast verlaagt RAG de drempel voor AI-adoptie aanzienlijk: organisaties hoeven geen dure fine-tuning trajecten te doorlopen om hun model bedrijfsspecifieke vragen te laten beantwoorden, omdat de relevante kennis dynamisch wordt opgehaald uit bestaande documentatie.

Veelgemaakte fouten met RAG

Een veelgemaakte fout is RAG implementeren zonder aandacht voor chunking-strategie en embedding-kwaliteit. Slecht gesegmenteerde documenten leiden tot irrelevante retrievals en daarmee onbetrouwbare antwoorden die het vertrouwen van eindgebruikers ondermijnen. Investeer in een solide data-pipeline en evaluatieframework voordat u het systeem live zet. Een tweede valkuil is het verwaarlozen van documentkwaliteit: als de brondocumenten verouderd, tegenstrijdig of slecht gestructureerd zijn, zal het RAG-systeem deze problemen weerspiegelen in de output, ongeacht hoe geavanceerd de retrieval is. Daarnaast onderschatten teams vaak het belang van re-ranking: enkel vertrouwen op vectorsimilarity leidt regelmatig tot minder relevante resultaten dan wanneer een cross-encoder de top-resultaten herschikt op basis van de werkelijke vraag-documentrelevantie. Tot slot vergeten organisaties evaluatie in te richten na de initiële lancering, waardoor degradatie in antwoordkwaliteit door veranderende of aangroeiende brondata onopgemerkt blijft. Het gebruik van evaluatieframeworks zoals RAGAS of DeepEval maakt het mogelijk om faithfulness en relevance continu te meten en automatisch alerts te genereren wanneer scores onder een vooraf gedefinieerde drempel zakken. Investeer daarnaast in hybrid search die BM25-keyword matching combineert met dense vector retrieval voor betere recall bij exacte termen zoals productnummers en juridische referenties.

Welke voorbeelden zijn er van RAG?

- Een HR-afdeling die een RAG-systeem implementeert waarmee medewerkers in natuurlijke taal vragen kunnen stellen over bedrijfsbeleid, arbeidsvoorwaarden en procedures. Antwoorden verwijzen altijd naar de actuele brondocumenten met paginanummers, zodat medewerkers de informatie zelf kunnen verifiëren en HR minder herhalende vragen ontvangt.

- Een technisch supportteam dat RAG inzet om een kennisbank van duizenden producthandleidingen en troubleshooting-guides doorzoekbaar te maken via een AI-chatbot. Supportmedewerkers vinden sneller de juiste oplossing en de gemiddelde oplostijd daalde met 45%, terwijl de klanttevredenheid meetbaar steeg.

- Een juridische afdeling die RAG gebruikt om relevante jurisprudentie en wetsartikelen op te halen bij het opstellen van contracten. Juristen werken altijd met de meest actuele regelgeving en besparen uren onderzoekstijd per contract doordat de AI relevante passages direct presenteert met bronverwijzingen.

- Een farmaceutisch bedrijf dat RAG toepast om onderzoekers toegang te geven tot duizenden wetenschappelijke publicaties via een interne AI-assistent. De assistent haalt relevante studies op, vat bevindingen samen en geeft directe links naar de originele papers, wat het literatuuronderzoek versnelt van dagen naar minuten.

- Een verzekeringsmaatschappij die RAG implementeert voor schadeafhandeling, waarbij de AI-assistent automatisch relevante polisvoorwaarden en eerdere claimbesluiten ophaalt wanneer een medewerker een nieuwe schadeclaim beoordeelt. Dit zorgt voor consistentere besluitvorming en verkort de verwerkingstijd per claim aanzienlijk.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

Kennisbank: Generatieve AI van definitie tot implementatie

Zo past het in je stack: Generatieve AI creëert originele tekst, beeld en code op basis van prompts, van LLM\'s als GPT en Claude tot diffusiemodellen…

Prompt Engineering ontrafeld: wat het is en hoe je ermee werkt

Meetbaar verschil: Prompt engineering is de kunst van het formuleren van effectieve AI-instructies met technieken als chain-of-thought, few-shot en…

Vector database wanneer zoeken op betekenis telt

Dit is onmisbaar voor RAG, semantisch zoeken en AI-toepassingen. vector databases slaan embeddings op en voeren razendsnelle similarity searches uit.

Concrete Chatbot Implementatie cases uit onze projecten

Voor teams die chatbot Implementatie serieus willen aanpakken: inspiratie uit de praktijk, zonder marketingpraat.

Uit onze blog

Introductie Refront: AI-Gestuurde Workflow Automatisering van Ticket tot Factuur

Sidney · 9 min leestijd

TypeScript Haalt Python In als Populairste Taal op GitHub: Dit Is Waarom Het Ertoe Doet

Sidney · 8 min leestijd

Anthropic's Code Review Tool: Waarom AI-Gegenereerde Code AI-Review Nodig Heeft

Sidney · 7 min leestijd