Caching begrijpen: de complete gids

Voor teams die schaalbaar bouwen: Caching slaat veelgebruikte data dichterbij de gebruiker op (browser-, CDN- en serverniveau), wat zorgt voor…

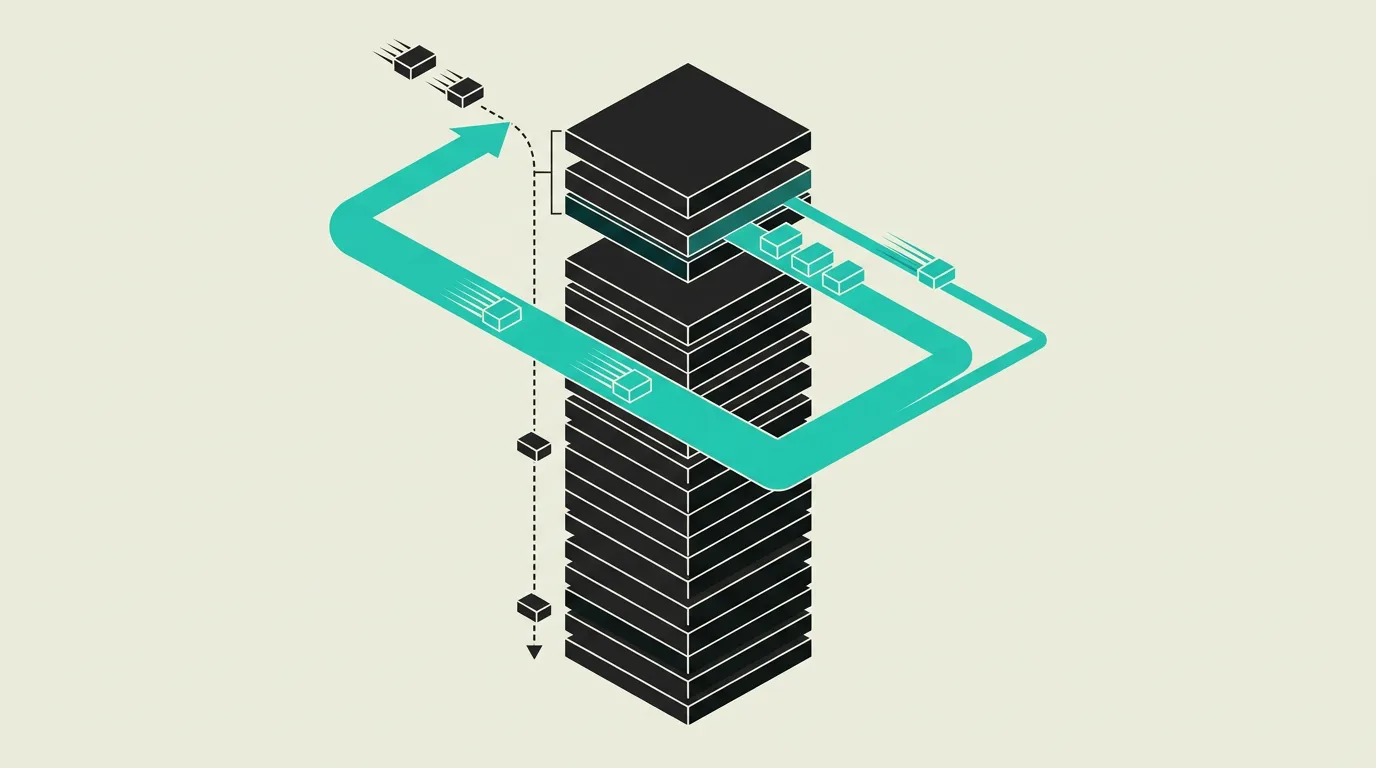

Caching is het tijdelijk opslaan van data op een sneller toegankelijke locatie zodat toekomstige verzoeken sneller worden afgehandeld zonder de oorspronkelijke bron opnieuw te belasten. Het vermindert de belasting op databases en servers, verlaagt netwerk-latency en verbetert de gebruikerservaring aanzienlijk. Caching is een van de meest effectieve performance-optimalisaties in softwareontwikkeling en vindt plaats op meerdere lagen, van de browser van de eindgebruiker tot in-memory datastores op de server.

Wat is Caching begrijpen: de complete gids?

Caching is het tijdelijk opslaan van data op een sneller toegankelijke locatie zodat toekomstige verzoeken sneller worden afgehandeld zonder de oorspronkelijke bron opnieuw te belasten. Het vermindert de belasting op databases en servers, verlaagt netwerk-latency en verbetert de gebruikerservaring aanzienlijk. Caching is een van de meest effectieve performance-optimalisaties in softwareontwikkeling en vindt plaats op meerdere lagen, van de browser van de eindgebruiker tot in-memory datastores op de server.

Hoe werkt Caching begrijpen: de complete gids technisch?

Caching vindt plaats op meerdere lagen, elk met eigen karakteristieken. Browser-caching slaat statische assets (CSS, JS, afbeeldingen, fonts) lokaal op via Cache-Control headers (max-age, immutable) en ETag/Last-Modified headers voor conditional requests. CDN-caching plaatst kopieën op edge-servers wereldwijd voor snelle levering, gestuurd door s-maxage en stale-while-revalidate headers. Server-side caching met Redis of Memcached slaat berekende resultaten, database-queries en API-responses op in het geheugen voor sub-milliseconde toegang. Application-level caching via frameworks (Next.js ISR met on-demand revalidation, React Query met staleTime, SWR met deduplicatie) cacht pagina's of API-responses op applicatieniveau. De moeilijkste uitdaging in caching is invalidatie: bepalen wanneer gecachte data verouderd is. Strategieën omvatten TTL-based invalidatie (data verloopt automatisch na een configureerbare periode), event-based invalidatie (cache wordt geleegd wanneer de onderliggende data wijzigt, via database triggers of message queue events), tag-based invalidatie (gerelateerde cache entries groeperen en in een keer invalideren), en stale-while-revalidate (serveer gecachte data onmiddellijk terwijl op de achtergrond verse data wordt opgehaald). Cache-aside (lazy loading) is het meestgebruikte patroon: de applicatie controleert eerst de cache, en bij een miss wordt de bron bevraagd en het resultaat gecacht voor volgende verzoeken. Write-through caching schrijft gelijktijdig naar cache en database, wat consistentie garandeert ten koste van hogere schrijf-latency. Write-behind caching schrijft eerst naar de cache en asynchroon naar de database, wat sneller is maar risico op dataverlies bij crashes introduceert. Cache stampede prevention via distributed locking of request coalescing voorkomt dat bij een mass cache miss alle verzoeken tegelijk de database belasten. Consistent hashing verdeelt cache keys over een ring van servers, waardoor bij het toevoegen of verwijderen van een node slechts een fractie van de keys opnieuw wordt verdeeld in plaats van de volledige cache. Dit voorkomt massale cache misses bij schaalwijzigingen. Cache warming vult de cache proactief voor verwachte piekbelasting, bijvoorbeeld door populaire productpagina's vooraf op te halen na een deployment. HTTP Vary-headers sturen conditionele caching op basis van request-kenmerken zoals Accept-Language of Accept-Encoding, zodat verschillende representaties van dezelfde URL correct worden gecacht. Bloom filters kunnen worden ingezet om snel te bepalen of een key zeker niet in de cache aanwezig is, wat onnodige cache-lookups voorkomt en de belasting op de cachelaag vermindert.

Hoe past MG Software Caching begrijpen: de complete gids toe in de praktijk?

Bij MG Software implementeren we een meerlaagse cachingstrategie in elk project. Next.js ISR cacht pagina's op build-time met on-demand revalidation voor content-updates. Vercel's edge cache serveert statische content met content-hashed URLs en lange max-age headers. Redis gebruiken we voor server-side caching van dure database-queries en externe API-responses, met TTL-gebaseerde invalidatie en cache-key namespacing per tenant. React Query aan de clientzijde deduplicateert gelijktijdige verzoeken en toont gecachte data terwijl verse data wordt opgehaald. Na elke deployment triggeren we automatisch cache warming voor de meest bezochte pagina's. Cache-key schema's documenteren we in de repository zodat het team begrijpt welke data gecacht wordt en wanneer invalidatie plaatsvindt. Bij multi-tenant projecten isoleren we cache namespaces per klant met geautomatiseerde tests die cross-tenant leakage detecteren. We monitoren cache hit rates via dashboards om de effectiviteit te meten en de configuratie continu te optimaliseren.

Waarom is Caching begrijpen: de complete gids belangrijk?

Caching is vaak het verschil tussen een applicatie die snappy aanvoelt en een die traag is. Door veelgebruikte data dicht bij de gebruiker op te slaan, verlaag je latency van honderden milliseconden naar enkele milliseconden. Google's onderzoek toont aan dat elke extra 100 milliseconden laadtijd de conversieratio met 1% kan verlagen. Een goed geconfigureerde cachingstrategie reduceert de databasebelasting met 80 tot 95 procent, wat directe besparingen oplevert op infrastructuurkosten. Voor applicaties met wereldwijde gebruikers verkort CDN-caching de latency van honderden naar tientallen milliseconden, ongeacht de geografische afstand tot de origin server. Dit vertaalt zich direct naar betere Core Web Vitals scores, hogere Google-rankings, lagere infrastructuurkosten en een betere conversieratio. Voor bedrijven met hoog verkeer is een goede cachingstrategie het verschil tussen een stabiele applicatie en een die onder piekbelasting bezwijkt.

Veelgemaakte fouten met Caching begrijpen: de complete gids

Cache-aside zonder consistent sleutelschema: alles heet user-data en tenants overschrijven elkaars data. TTL staat op dagen voor prijzen die elk uur wijzigen, waardoor klanten verkeerde bedragen zien. Na deploys blijft oude JavaScript hangen omdat niemand CDN-cache purgeert of content-hashed URLs gebruikt. Write-through en database raken uit sync bij partial failures en timeouts. Bij piekbelasting stormt iedereen tegelijk de database in na een gedeelde cache-miss zonder locking of request coalescing (thundering herd). Cache hit rates worden niet gemonitord, dus niemand weet of de cache daadwerkelijk effectief is. Cache warmup ontbreekt na deployments, waardoor de eerste honderden gebruikers trage responses ervaren terwijl de cache opnieuw wordt opgebouwd. Serialisatie-overhead wordt onderschat: grote objecten worden in JSON gecacht terwijl compactere formaten zoals MessagePack de cache-geheugenefficiëntie verdubbelen.

Welke voorbeelden zijn er van Caching begrijpen: de complete gids?

- Een nieuwswebsite die Next.js ISR gebruikt om artikelpagina's te cachen en via on-demand revalidation bij te werken wanneer een redacteur content publiceert via het CMS, zodat artikelen direct snel laden en altijd actueel zijn zonder volledige rebuilds.

- Een e-commerce platform dat Redis inzet om productcatalogus-queries te cachen met TTL van 5 minuten, waardoor de database slechts een fractie van de verzoeken verwerkt en productpagina's consistent in milliseconden laden, zelfs tijdens verkooppieken.

- Een webapplicatie die stale-while-revalidate cache headers gebruikt zodat gebruikers direct gecachte content zien terwijl op de achtergrond verse data wordt opgehaald, wat resulteert in instant pageloads zonder verouderde content.

- Een SaaS-dashboard dat React Query gebruikt om API-responses client-side te cachen met een staleTime van 30 seconden, waardoor navigatie tussen pagina's instant voelt en herhaalde verzoeken gededupliceerd worden.

- Een multi-tenant platform dat Redis-cache keys prefixed met tenant-ID's zodat gecachte data per klant geïsoleerd is en cache-invalidatie van de ene klant geen impact heeft op een andere.

Gerelateerde begrippen

Veelgestelde vragen

Wij bouwen hier dagelijks mee

Dezelfde expertise waar u over leest, zetten wij in voor opdrachtgevers in Nederland en daarbuiten.

Ontdek wat wij doenGerelateerde artikelen

Kennisbank: Redis van definitie tot implementatie

Snel inzicht: Redis slaat data op in het geheugen voor microseconde-toegangstijden: onmisbaar voor caching, sessies, real-time leaderboards en pub/sub…

Zo werkt een CDN: uitleg, voordelen en valkuilen

Van proof-of-concept tot productie: Een CDN serveert webcontent vanuit edge-locaties wereldwijd, waardoor laadtijden drastisch afnemen en de belasting…

Wanneer kies je Redis boven Memcached?

Twijfel je tussen simpele cache of data-features? Pub/sub, structures en persistence maken Redis vaak breder inzetbaar.

Kennisbank: WebAssembly van definitie tot implementatie

WebAssembly (Wasm) draait gecompileerde code van C++, Rust en Go in de browser met bijna-native snelheid. Leer hoe Wasm werkt en wanneer je het inzet.